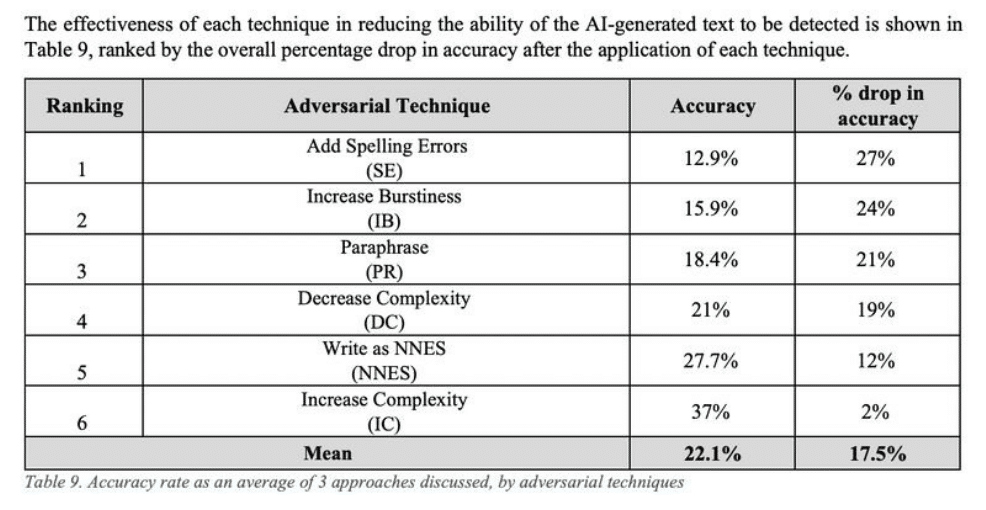

KI-Erkennungssoftware funktioniert nicht. Punkt. Eine aktuelle Studie akademischer Forscher zeigt, dass diese Tools äußerst unzuverlässig sind. Wenn einfache Anti-Erkennungstechniken verwendet werden, verschlechtert sich ihre begrenzte Genauigkeit noch weiter.

Dies bedeutet, dass diese Tools, wenn sie KI-Betrug erkennen, nur schlecht ausgeführte Versuche aufdecken. Bildungseinrichtungen verlassen sich bei Internetrecherchen und Wikipedia-Inhalten auf Tools zur Plagiatserkennung. Es erscheint logisch, nach ähnlichen Lösungen für GenAI zu suchen, aber diese Tools sind einfach nicht zweckmäßig und können sogar Schaden anrichten, wie der Fall eines UNG-Studenten zeigt, der wegen der Verwendung von Grammarly auf Bewährung gesetzt wurde.

Die Zukunft liegt nicht in diesen Detektoren. Stattdessen müssen wir unsere Gespräche über akademische Integrität dahingehend verlagern, wie sich die Bewertung im Zeitalter der GenAI weiterentwickeln muss.

Mehr zur Studie finden Sie hier HIER.